[보안 이슈] “AI 보안 전략 2026: ‘AI for Security’와 ‘Security for AI’, 보안 담당자가 반드시 알아야 할 5가지 핵심 포인트”

AI 보안 전략 2026: ‘AI for Security’와 ‘Security for AI’, 보안 담당자가 반드시 알아야 할 5가지 핵심 포인트

클라이언트사의 CISO와 미팅을 하다 보면 어느 순간부터 회의 주제가 달라졌다는 걸 체감한다. 불과 2년 전까지만 해도 “랜섬웨어 대응 체계를 어떻게 고도화할 것인가”가 주 의제였다면, 지금은 “우리 회사에 도입한 생성형 AI는 안전한가”, “AI가 공격에 쓰이면 우리 SOC는 감당할 수 있는가”라는 질문이 테이블 위에 올라온다. 이것이 2026년 AI 보안 전략의 현주소다.

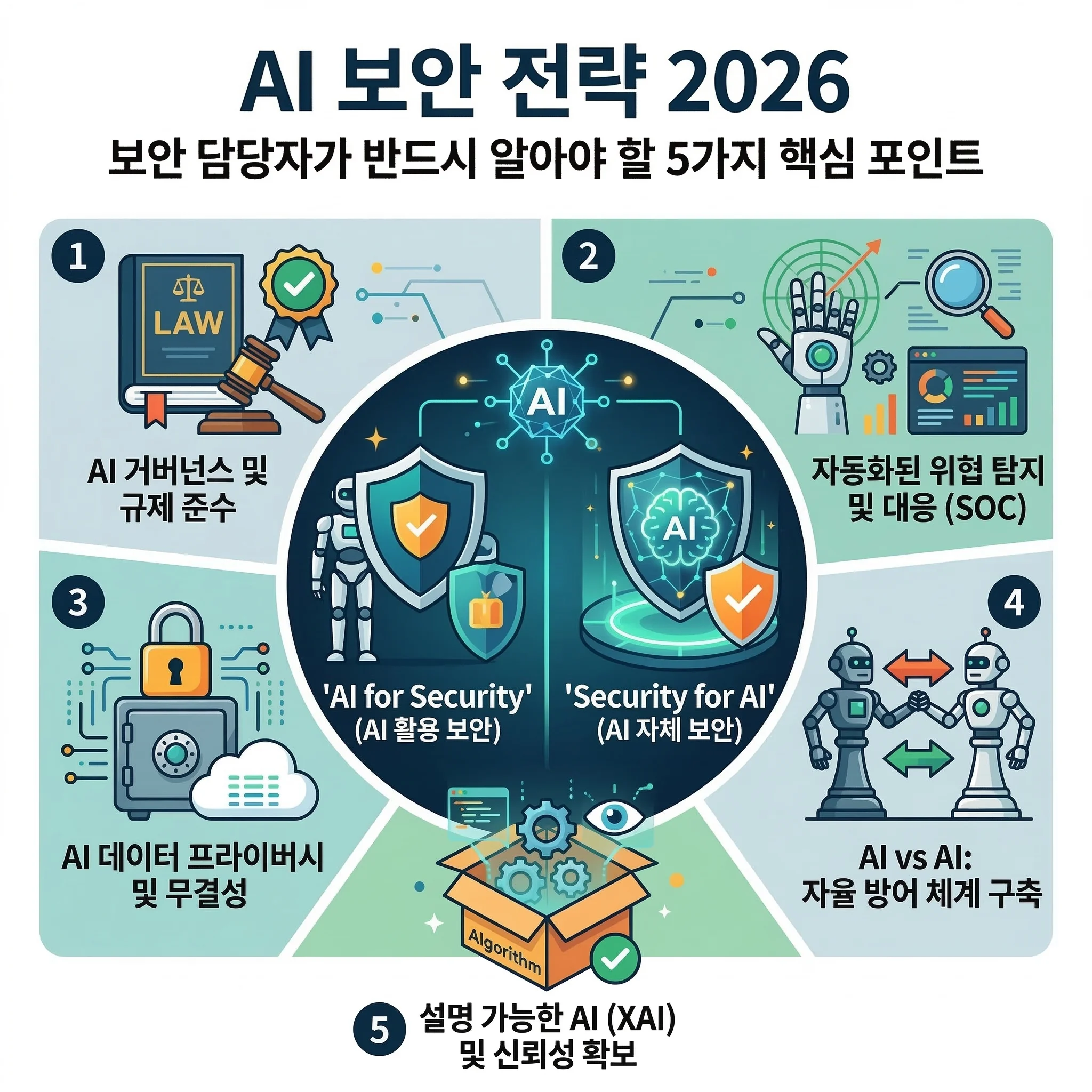

문제는 “AI와 보안”이라는 화두가 실무에서 두 가지 전혀 다른 방향으로 혼재하여 사용된다는 점이다. 하나는 AI를 보안 도구로 활용하는 방향(AI for Security)이고, 다른 하나는 AI 시스템 자체를 보호하는 방향(Security for AI)이다. 이 두 개념을 명확히 구분하지 못하면, 예산과 인력을 잘못된 곳에 집중하는 전략적 오류를 범하게 된다.

보안 서비스 시장

AI 보안 포함

OWASP LLM Top10

에이전트 프레임워크

출처: IDC 보안 서비스 시장 보고서(2024), OWASP Top 10 for LLM 2025, Barracuda Security Report(2025.11)

개념 분리: ‘AI for Security’ vs ‘Security for AI’

실무 현장에서 두 개념이 혼용되는 이유는 한국어로 옮기면 모두 ‘AI 보안’으로 표현되기 때문이다. 하지만 영어 원문을 보면 방향성이 정반대임을 알 수 있다. 마이크로소프트 보안 블로그는 이를 명확히 이렇게 정의한다.

“사이버 보안을 위한 AI(AI for Security)는 AI 도구를 사용하여 위협을 탐지·대응·완화하는 조직의 능력을 향상시키는 것이며, AI 보안(Security for AI)은 AI 시스템 자체를 보호하는 것으로, AI 모델·데이터·알고리즘을 위협으로부터 방어하기 위한 전략과 도구를 포함한다.” — Microsoft Security, ‘What is AI for Cybersecurity’

🛡️ 보안을 위한 AI

목적: 기존 사이버 위협으로부터 조직을 보호하기 위해 AI를 수단으로 활용

핵심 질문:

“AI가 우리 보안을 강화할 수 있는가?”

- AI 기반 SIEM·SOAR 자동화

- 머신러닝 이상 행위 탐지(UEBA)

- AI 위협 인텔리전스 분석

- 딥페이크·피싱 탐지 알고리즘

- 자동화된 취약점 스캐닝

🔒 AI를 위한 보안

목적: AI 시스템·모델·데이터 자체를 공격으로부터 보호

핵심 질문:

“우리의 AI 시스템은 안전한가?”

- 프롬프트 인젝션 방어

- 모델·학습 데이터 무결성 보호

- LLM 에이전트 과도한 권한 통제

- AI 공급망 보안 검증

- AI Guardrail·레드팀 운영

출처: Microsoft Security Blog, Red Hat AI Security 가이드, OWASP Top 10 for LLM 2025

두 개념의 차이를 한 문장으로 정리하면 이렇다. AI for Security는 AI가 ‘주체’가 되어 보안 업무를 수행하는 것이고, Security for AI는 AI가 ‘객체’가 되어 보호받아야 하는 것이다. 그리고 지금 우리가 맞닥뜨린 현실은, 이 두 방향을 동시에 추진하지 않으면 AI가 오히려 가장 큰 공격 표면이 된다는 역설이다.

업무 적용

공급망 취약

타깃 공격

대응 필요

AI 도입 → 공격 표면 확장 → 고도화된 위협 → 통합 AI 보안 전략 수립이 필수 사이클

CISO와 보안 컨설턴트가 직면한 3가지 현실

실제 기업 현장에서 AI 보안 전략을 논의할 때 자주 목격하는 패턴이 있다. 경영진은 “AI를 도입하자”고 속도를 내고, 보안팀은 “검토가 필요하다”며 제동을 건다. 그러나 정작 어떤 기준으로 검토해야 하는지 프레임워크가 없어 논의가 공회전한다. 이것이 지금 현장의 첫 번째 현실이다.

- AI 도입 전 리스크 평가 체계 부재

- LLM 사용 정책·거버넌스 미비

- 보안 예산 내 AI 보안 항목 미분류

- AI 공급망 검증 절차 부재

- 임직원 AI 사용 이상 행위 모니터링 공백

- AI Guardrail·레드팀 운영 경험 부족

- 기존 보안 프레임워크(ISMS-P 등) 내 AI 항목 공백

- 클라이언트별 AI 사용 범위 파악 어려움

- OWASP LLM·MITRE ATLAS 기반 진단 역량 필요

- AI 수명주기(Lifecycle) 보안 진단 방법론 개발

- AI 특화 모의침투(AI Red Team) 방법론 부재

- 규제·컴플라이언스(AI기본법) 선제 대응 필요

출처: CIO Korea 「2025 AI·사이버보안 주요 과제 7가지」, 삼성SDS 「2026 사이버보안 위협 트렌드」

“실제로는 리스크 분석, 명확한 정책, 절차, 기술 통제 중 어느 하나에도 충분한 투자를 하지 않은 조직이 대부분이며, LLM이 유발하는 보안 문제의 규모를 외면하고 있다.” — 조셉 스타인버그, 사이버보안·AI 전문가 (CIO Korea, 2025.05)

두 번째 현실은 속도의 비대칭이다. 공격자는 이미 AI를 활용해 공격을 자동화·정교화하고 있는데, 방어 측의 AI 보안 전략 수립은 이를 따라가지 못하고 있다. 시큐아이가 발표한 2025년 5대 보안 트렌드에서도 “AI 기반 사이버 위협과 보안 기술이 동시에 확대되는 양날의 검 구도”를 첫 번째 트렌드로 꼽았다. 세 번째 현실은 규제 공백이다. 국내 AI기본법이 2026년 1월 시행되었으나, ISMS-P 등 기존 인증 체계 내에 AI 보안 항목은 여전히 명시적으로 분리되어 있지 않다. 컨설턴트 입장에서 이 공백은 곧 새로운 서비스 영역이다.

2026년 AI 보안 영역에서 주목해야 할 5가지 핵심 위협

AI 보안 전략을 수립하기 위해서는 먼저 위협 지형을 정확히 파악해야 한다. 아래 5가지는 OWASP Top 10 for LLM 2025, MITRE ATLAS, 삼성SDS·Barracuda Security 연구보고서를 교차 분석한 결과다.

-

01최고 위험

프롬프트 인젝션 (Prompt Injection)

공격자가 자연어 입력을 조작해 LLM이 의도하지 않은 명령을 실행하도록 유도. OWASP LLM Top 10 2023 발표 이후 2025년까지 연속 1위. MS 365 코파일럿의 ‘EchoLeak(CVE-2025-32711)’처럼 일반 업무 파일에 숨겨진 제로클릭 공격까지 진화.

-

02최고 위험

AI 에이전트 과도한 자율성 (Excessive Agency)

LLM 에이전트에 부여된 과도한 권한이 오남용될 경우, 데이터 유출·시스템 침해로 연결. 삼성SDS 보고서에 따르면 “AI Agent의 과도한 위임 및 남용은 2026년 주요 위협”으로 분류. 에이전트 메모리 오염 공격은 수주 후 지연 실행되어 탐지가 극히 어려움.

-

03높음

AI 공급망 취약점 (AI Supply Chain Attack)

Barracuda Security 보고서(2025.11)는 공급망 침해로 유입된 취약 에이전트 프레임워크 구성요소 43개를 확인. 오픈소스 LLM 라이브러리·파인튜닝 데이터셋·외부 API 플러그인이 모두 공격 진입점이 됨. 침해 인지 시점에는 백도어가 이미 수개월 전 설치된 상태.

-

04높음

학습 데이터 오염 및 모델 중독 (Data/Model Poisoning)

공격자가 파인튜닝 데이터셋에 악성 트리거를 심어 특정 조건 하에 오작동을 유발. RAG(검색 증강 생성) 환경에서 외부 문서 오염을 통한 간접 공격도 확인. 생성형 AI가 잘못된 정보를 “사실”로 제시하는 할루시네이션과 결합 시 법적·윤리적 리스크 급증.

-

05높음

딥페이크 기반 사회공학 공격 (AI-powered Social Engineering)

2025년 9월 국제 엔지니어링 기업 아럽(Arup)의 딥페이크 사기로 2,500만 달러 손실 발생. 영상·음성 변조 기술 고도화로 KYC·내부 승인 프로세스 무력화 가능. CIO Korea는 “2025~2026년 이후 AI 기반 디지털 속임수가 일상화될 것”이라고 경고.

출처: OWASP Top 10 for LLM 2025, Barracuda Security Report(2025.11), 삼성SDS 2026 보안위협 트렌드, CIO Korea, Stellar Cyber

보안 담당자·컨설턴트가 나아가야 할 방향성 7가지

위협 지형을 파악했다면 이제 AI 보안 전략의 실행 방향을 정해야 한다. 현장 경험과 주요 프레임워크를 기반으로 정리한 7가지 방향성이다.

🗂️ AI 사용 현황 인벤토리 수립

조직 내 어떤 AI 도구·LLM·에이전트가 어떤 권한으로 운영 중인지 파악. 가시성 없이는 통제도 없다. AI 자산 관리 대장을 기존 IT자산 관리 체계에 통합.

📋 AI 사용 정책 및 거버넌스 선제 수립

어떤 데이터를 AI에 입력할 수 있는지, 어떤 플러그인을 허용하는지 명문화. AI기본법(2026.01 시행) 요건을 선제 반영한 내부 정책 수립 필수.

🔴 AI Red Team 도입 및 모의침투

기존 모의해킹에 AI 특화 공격 기법(프롬프트 인젝션·에이전트 조작) 추가. MITRE ATLAS 기반 공격 전술 목록을 활용한 AI 레드팀 운영 체계 구축.

🛡️ AI Guardrail 및 입출력 모니터링

LLM 입력·출력 전 과정을 실시간 모니터링하고 이상 패턴 차단. 삼성SDS는 “AI Guardrail 적용과 AI 수명주기 전 단계 통제”를 2026년 핵심 대응으로 권고.

🔗 AI 공급망 보안 검증 체계

외부 LLM API·오픈소스 모델·플러그인 도입 시 출처 검증·무결성 확인·라이선스 점검을 의무화. 계약 단계부터 AI 공급망 보안 조항 삽입.

📊 ISMS-P 내 AI 보안 항목 자체 확장

현행 ISMS-P 인증 체계에 AI 모델 보호·LLM 접근 통제·데이터 오염 방지 항목을 자체 추가하여 운영. 향후 인증 기준 개편에 선제 대응 포지셔닝.

🎓 AI 보안 인식 교육 체계 구축

임직원 대상 AI 사용의 보안 위험성 교육(프롬프트에 개인정보·기밀 입력 금지 등)과 딥페이크 대응 시나리오 훈련을 정기 운영. 기술보다 사람이 가장 큰 취약점.

출처: 삼성SDS 2026 보안위협 트렌드, OWASP LLM Security, MITRE ATLAS, KISA AI 보안 이슈(2025)

보안 컨설턴트에게 열리는 새로운 서비스 영역

컨설턴트 관점에서 이 흐름은 위기이자 기회다. 클라이언트가 묻기 시작했다. “우리 AI는 안전한가?” 그 질문에 답하려면 OWASP Top 10 for LLM, MITRE ATLAS, AI Lifecycle Security 진단 방법론을 내재화해야 한다. 기존 ISMS-P·ISO 27001 컨설팅에 AI 특화 진단 모듈을 더한 확장형 서비스, AI 레드팀 운영 위탁, AI 보안 정책 수립 컨설팅이 2026년 이후 성장하는 시장이 될 것이다.

※ 조직 규모와 AI 도입 성숙도에 따라 단계 조정 필요

AI 보안 전략, 양날의 검을 어떻게 다룰 것인가

시큐아이는 2025년 보안 트렌드를 발표하며 AI를 “양날의 검”이라 표현했다. 이 표현이 적확한 이유는, AI가 보안팀의 탐지 역량을 10배로 높이는 동시에 공격자의 공격 속도도 10배로 빠르게 만들기 때문이다. 문제는 현장에서 이 둘을 별개로 취급하다가 둘 다 놓치는 경우가 너무 많다는 것이다.

📌 핵심 요약: AI for Security는 AI를 보안 도구로 삼아 탐지·대응·자동화를 강화하는 것이고, Security for AI는 AI 시스템 자체를 공격으로부터 보호하는 것이다. 2026년 이후의 AI 보안 전략은 이 두 축을 동시에 추진하되, 조직의 AI 도입 수준과 리스크 프로파일에 맞게 우선순위를 조정하는 것이 핵심이다.

기업 보안 담당자라면 오늘부터 할 수 있는 일이 있다. 조직 내에서 사용 중인 AI 도구 목록을 만들어라. 어떤 데이터가 그 AI에 입력되고 있는지 파악하라. 그것만으로도 AI 보안 전략의 절반은 시작된 것이다. 보안 컨설턴트라면 클라이언트의 다음 질문에 대비해야 한다. “우리 AI, 진단해줄 수 있어요?” OWASP LLM Top 10과 MITRE ATLAS를 지금 당장 내재화하는 것이 그 준비의 시작점이다.

AI가 만들어내는 위협의 속도는 인간의 검토 속도를 이미 앞질렀다. 그렇기 때문에 AI 보안 전략은 기술의 문제만이 아니라 거버넌스·정책·인식의 문제다. 기술팀과 컴플라이언스 팀이 함께 앉아야 하고, 경영진이 AI 보안을 비용이 아닌 사업 연속성의 필수 조건으로 인식해야 한다. 그 인식의 전환을 이끄는 것, 그것이 지금 이 시대 보안 전문가의 가장 중요한 역할이다.

- Microsoft Security — 사이버 보안을 위한 AI란 무엇인가

- Red Hat — AI 보안이란? (Security for AI 개념 정의)

- 삼성SDS — 2026년 사이버 보안 위협 트렌드 전망 및 대응

- 삼성SDS — LLM에서 자주 발생하는 10가지 주요 취약점 (OWASP LLM Top 10)

- CIO Korea — AI가 보안에 도움될까? 2025년 AI·사이버보안 주요 과제 7가지

- CIO Korea — 강은성의 보안 아키텍트: LLM 애플리케이션 보안 (OWASP·MITRE ATLAS)

- CIO Korea — 매크로에 명령 숨기는 AI 공격 기법 (프롬프트 인젝션 진화)

- Stellar Cyber — 2026년 주요 에이전트형 AI 보안 위협

- 보안뉴스 — 시큐아이, 2025년 5대 보안 트렌드 발표 (AI 양날의 검)

- 이글루코퍼레이션 — 생성형 AI 시대, 이제는 보안이다 (2025)

- KISA — KISA Insight 2025 Vol.01: DeepSeek 등장과 AI 보안 이슈

- 정보통신기획평가원 — AI 시대의 사이버보안 기술 (과기정통부 연구)

- Introl — LLM 보안: 프롬프트 인젝션 방어 가이드 2025

- CELA Blog — 생성형 AI 보안 위험과 대응 전략 (OWASP LLM 2025 기반)

![[Sec Issue] 23 Million Mobile Subscribers’ Data Leaked: The Full Story Behind the 2025 SK Telecom SIM Breach and Future Preparations](https://ota2z.com/wp-content/uploads/2025/04/ChatGPT-Image-2025년-4월-28일-오후-07_46_11-768x512.webp)